7月6日,2023世界人工智能大会(WAIC)在上海正式开幕。本届大会的主题是“智联世界,生成未来”。来自本届WAIC首日公开消息:第 二代骁龙8移动平台的高通AI引擎荣获2023世界人工智能大会*奖项:SAIL奖——*人工智能引领者奖。高通公司全球副总裁侯明娟上台领奖。

第 二代骁龙8凭借面向整个平台的开创性AI智能设计赋能了非凡用户体验,树立了网联计算的新标杆,其搭载高通技术公司处理速度最快、最 先进的高通AI引擎,通过软硬件的一系列创新,相较上一代带来4.35倍的AI性能提升和60%的能效提升,从而为越来越多的创新型AI用例和AI增强的用户体验提供强大的性能基础。

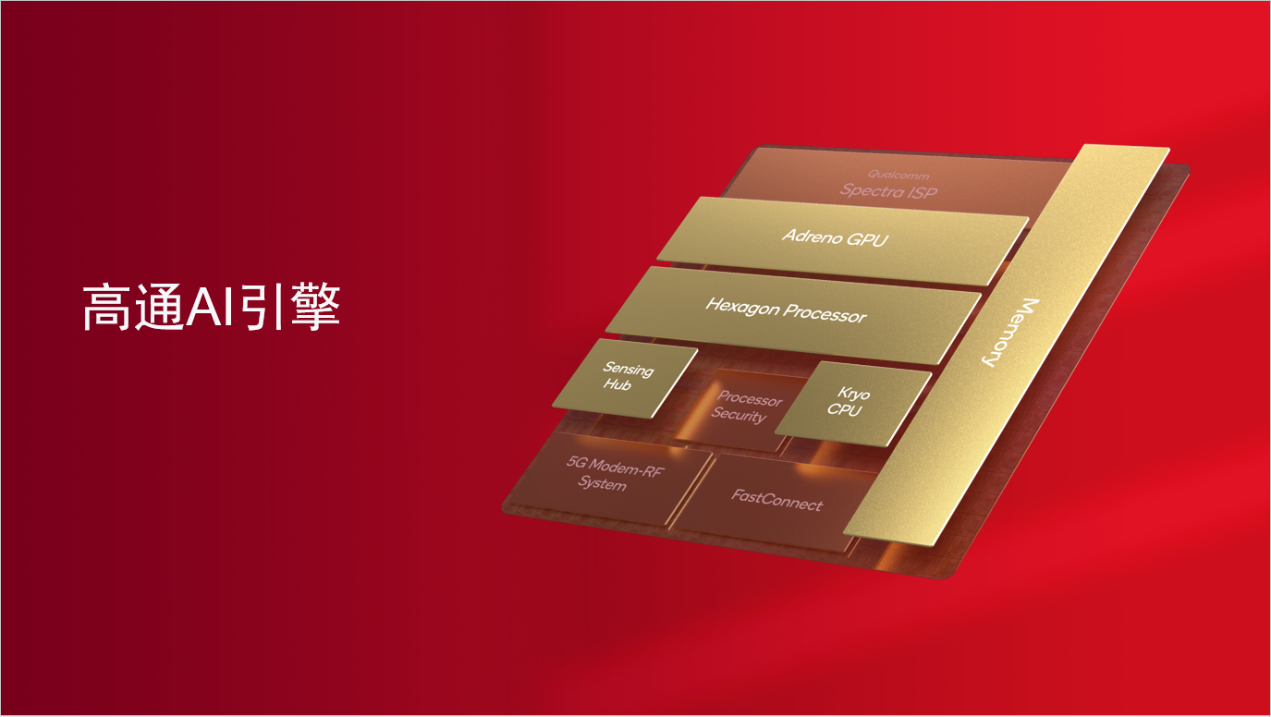

高通AI引擎由多个硬件和软件组件组成,用于在骁龙移动平台上为终端侧AI推理加速。它采用异构计算架构,包括高通Hexagon处理器、Adreno GPU、Kryo CPU和传感器中枢,共同支持在终端上快速而有效的运行AI应用程序。其关键核心Hexagon处理器拥有一系列创新:提供专用供电系统、支持微切片推理、INT4精度、Transformer网络加速等,可结合高通AI软件栈和AI Studio提供全栈AI能力和优化手段,行业内率先在终端侧支持Stable Diffusion、ControlNet等生成式AI用例,并可与云端协同打造适应大模型时代的混合AI处理框架,助力AI体验创新和生态繁荣。目前,第 二代骁龙8移动平台已经可以支持参数超过10亿的AI模型运行。未来几个月内,将有望支持参数超过100亿的模型在终端侧运行,这也将成为基于高通技术的产品的一大差异化优势。

终端侧AI处理可以带来处理时延,隐私和安全,可靠性等优势,并且在生成式AI场景下可以有效分担云端处理的负载,降低成本和能耗,有助于云端协同的混合式AI处理架构的有效部署。高通AI引擎可提供*的终端侧AI处理能力,并可跨越智能手机赋能更多边缘移动终端类别,比如笔记本电脑、XR头显、IoT设备以及汽车等,引领终端侧AI应用的进一步发展。

据悉,高通深耕AI研发已超过15年,高通AI Research在基础研究领域实现突破,并跨终端和行业进行扩展,以赋能智能网联边缘。高通AI Research不仅在开展全新AI研究工作,也率先在商用终端上展示概念验证,为在现实世界中的技术规模化应用铺平道路。高通AI Research的重要AI研究论文正在影响整个行业,推动高能效AI发展,并与公司所有团队通力合作,将最新AI发展成果和技术集成到高通产品之中,让实验室研究所实现的AI进步能够更快交付,丰富人们的生活。

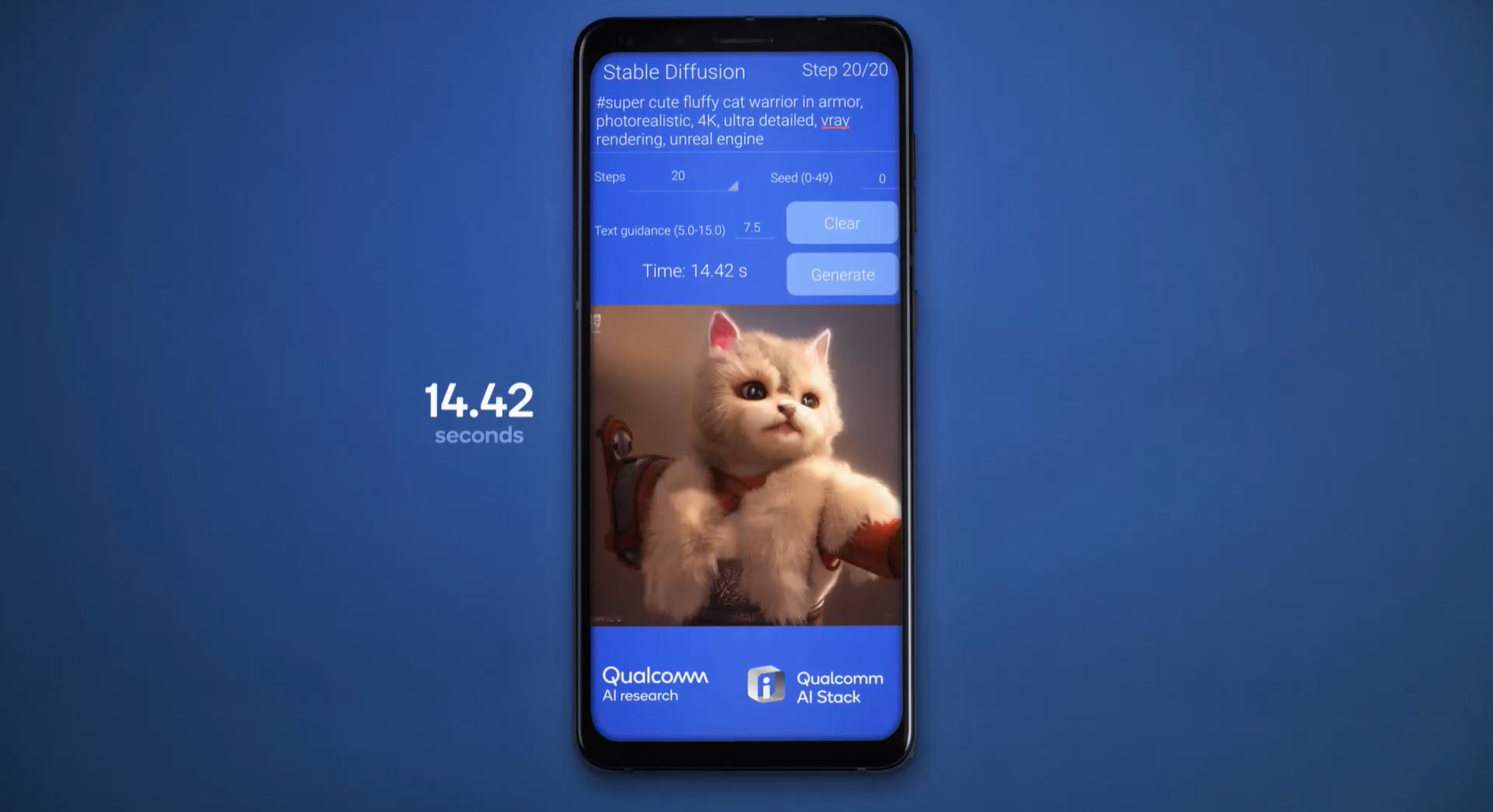

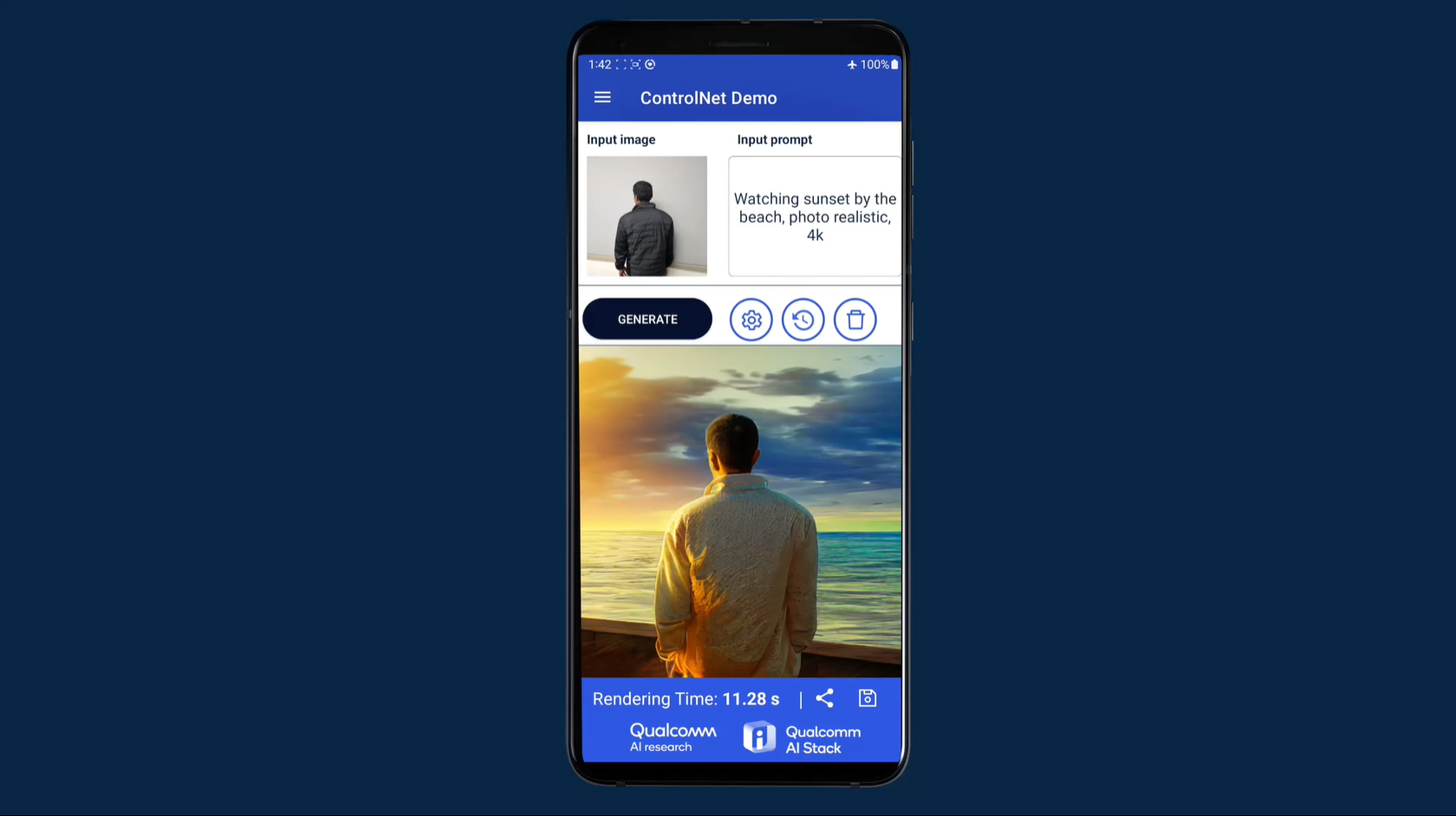

在WAIC现场,高通还带来了Stable Diffusion、ControlNet等生成式AI用例的技术展示。这是全球*运行在Android手机上的Stable Diffusion终端侧演示,和全球最快的手机上的ControlNet终端侧演示。

全球*运行在Android手机上的Stable Diffusion终端侧演示

全球最快的手机上的ControlNet终端侧演示

Stable Diffusion是一个非常出色的从文本到图像的生成式AI模型,能够基于任何文本输入,在数十秒内创作出逼真图像。其参数超过10亿,迄今为止主要限于在云端运行。高通采用全栈AI优化的方式,通过量化、编译和硬件加速进行优化,使其能在搭载第 二代骁龙8移动平台的手机上运行,在15秒内执行20步推理,生成一张512x512像素的图像。这是在智能手机上最快的推理速度,能媲美云端时延,且用户文本输入完全不受限制。目前,高通也已经将Stable Diffusion这一生成式AI用例扩展到搭载骁龙计算平台的PC产品上。

ControlNet图像生成图像模型是一项语言-视觉模型(LVM),拥有15亿参数,能够通过调整输入图像和输入文本描述,更精准地控制生成图像。在这项演示中,ControlNet能够在终端侧实现高效交互运行,通过一套跨模型架构、AI软件和神经网络硬件加速器的全栈式AI优化,时延12秒内可完成16步推理,生成AI图像,无需访问任何云端,便能提供高效、有趣、可靠且私密的交互式用户体验。高通AI模型增效工具包、高通AI软件栈和高通AI引擎在此过程中发挥了关键作用。

看了这篇文章的用户还看了

- 瞄准千亿级液冷市场,威派格(603956.SH)以流体底蕴开启硬核技术跃迁

- 平安人寿深圳分公司星级客户活动正式启动:以客户为中心,共启美好新篇章

- 大牌奶茶都在用什么基底乳?爆款的秘密藏在这口丝滑里

- 中国文艺网与百度APP签订战略合作协议,共创主流文艺传播新生态

- 光厂2025年度版权保护报告发布:持续加强版权保护,共筑创意产业新生态

- 元戎参加北京车展,CEO周光、首席科学家阮翀将于 25 日释放物理 AI 新信号

- 产学研合作项目数:美妆企业外部科研资源整合能力

- 全球首创亮相WFH大会!上海莱士发布SR604临床I/Ⅱ期数据,有望成为血友病新药

- 上半年扭亏为盈,顺丰同城成为即时物流盈利第 一股

- 全球骑士 逐鹿夏都丨金徽酒携手环青海湖国际公路自行车赛盛大开幕

- 三大极限挑战验证极致性能,央视推荐的雅迪冠能探索E10再创新骑迹

旗下微信矩阵:

旗下微信矩阵: