2007 年,英伟达创始人黄仁勋在东方卫视的一档电视节目中接受采访时,主持人将当时的英特尔、AMD 与英伟达的市场格局比喻为「三国演义」,黄仁勋纠正了他,表示这个说法「太过狭隘」,并预测二十年后最重要的不再是个人电脑或服务器市场,而是每个人口袋中的移动电脑。同时判断「索尼与苹果随时可能加入竞争」,英伟达必须做到每六个月进行一次技术迭代,让产品性能提升一倍。

彼时已经是智能手机爆发的前夜,但黄仁勋已经准确洞察到英伟达作为 GPU 供应商在其中的商机,英伟达也曾与小米合作,推出搭载英伟达芯片的小米手机以及 Android 平板电脑。虽然由于能耗控制以及市场规模不及对手等原因,英伟达最终放弃了智能手机业务。但黄仁勋所言的「每六个月一次技术迭代」却完整地传承了下来,还有就是原来不相干的公司也进入了芯片行业,比如微软和OpenAI。

对技术迭代的偏执追求是英伟达企业文化的重要部分:英伟达(Nvidia) 名字的灵感即来自 NV(next version意为“下一个版本”)与 Invidia(拉丁语中表示嫉妒的意思)。英伟达在 1993 年成立之时,硅谷有着数十家 GPU 制造商,但最终英伟达成为了*存活下来的选手。

与其说英伟达能存活下来是因为优秀的产品,不如说是因为英伟达有能力在达尔文式的适者生存的斗争中一次次幸存下来。过去近二十年,英伟达都保持着研发支出的*值高速增长,即使是在金融危机严重冲击科技产业的岁月,英伟达仍顶着连续两年净利润为负的压力,推动继续推进包括 CUDA 在内当时远看不到盈利可能的项目。

英伟达所销售的 GPU,是如今所有有意在 AI 生成式大模型领域创建成绩的初创企业的*选择,因此几乎所有涉足其中的厂商都「深受其害」—— 事实上很多如今英伟达的大客户,在过去二十年都曾因为 GPU 专利授权等问题与其对簿公堂,如今大肆购买英伟达 GPU 更像是战备行为,完全谈不上与英伟达建立在此之上更加深度的合作关系。

如今,在生成式对话大模型引发的 AI 浪潮半年之后,英伟达的客户们也纷纷露出原本竞争对手的面孔:十月初,The Information 也报道了微软与 AMD 在机器学习芯片领域的合作,相关计划从 2019 年已经开始进行,目前微软内部至少有 300 名员工在从事代号为「雅典娜」的芯片研究计划。

这颗芯片最初版本将采用 5nm 工艺,除了这个项目之外,微软同时还在结合此前多年在 SoC 领域的研发经验,与 AMD 合作推动 AI 芯片项目的研发。

作为 OpenAI 的投资人同时也是 ChatGPT 的获益者,微软从一开始就保留了自主选择的权利,OpenAI 也并没有完全臣服于微软,即使如今两家之间关于 AI 商业化道路上的「分钱」分歧日益加剧,分道扬镳似乎即将到来,但眼下显然有更迫切的问题亟待解决。

对 OpenAI 而言,训练下一代 GPT-5 以及日常运营 ChatGPT 的 GPU 成本一直占据着极大的比例,因此 OpenAI 涉足自研 GPU 芯片似乎也并不值得奇怪:近期有知情人士表示,OpenAI 目前同样也在计划自研芯片,但从零到一打造一款高性能 AI 芯片至少需要两年时间,因此 OpenAI 目前更倾向于寻找合适的芯片初创公司,将其收入麾下。OpenAI 现任 CEO Altman 参与投资的三家芯片公司:Cerebras、Rain Neuromorphics和Atomic Semi 都是有可能的收购对象。

成立于 1993 年的英伟达,在成立之后的二十多年中,在外界看来似乎都一直是一家在游戏显卡领域默默无闻的利基市场品牌,但直到 2015 年,伴随着元宇宙、自动驾驶以及最重要的人工智能概念形成,GPU 的算力成为了最宝贵的东西,英伟达才算成为了时代的宠儿 —— GPU 在面对深度学习计算场景中相比 CPU 的巨大优势让其一跃成为了所有人追捧的对象。全球各地开始兴建一大批用于加速计算的数据中心,GPU 的订单像雪片一般朝英伟达飞来。

虽然黄仁勋提出 GPU 效能每两年增加一倍的「黄氏定律」在业内颇受质疑,但每年英伟达 GPU 的涨幅却似乎严格遵守着这一定律:2020 年发布的 A100 单片售价约 10000 美元,到了今年的 H100 单片售价已经飙升至 30000 美元。

即便如此,相比 A100,H100 训练大模型的效率也有 200% 的提升,搭配英伟达用于服务器集群的运算方式,训练速度最高能提升至前者的九倍,大模型公司普遍追捧的「单美元效率」反而更高。这样一来,买英伟达 GPU 似乎已经只剩下「有钱多买、没钱少买」这两个选项。

2023 年 8 月,AI 云服务初创公司 CoreWeave 宣布获得 23 亿美元的债务融资,但这家估值仅为 20 亿美元的公司拿出的抵押物,就是他们手上现有的 H100 GPU,以及得益于与英伟达良好的合作关系、承诺优先供货 H100 的订单。

《对这家创业公司而言,英伟达 GPU 就是货币》2023.08.09 The Verge 报道标题。

有限的产能叠加市场狂热的需求,这让黄仁勋宣布英伟达是「AI 时代的台积电」都像是谦虚之辞 —— 即使是 2022 年台积电也仅占据了全球晶圆代工产能的 60%,而英伟达到今天已经占据了可用于机器学习的图形处理器市场 95% 的份额。

既然英伟达能成为「AI 时代的台积电」,为什么其他厂商不可以?

连马斯克曾都惊呼「获得 GPU 比获得毒品还难」—— 更早之前,他还在 Twitter 吐槽过「好像现在连狗都在买 GPU」,随即他也加入了抢购 GPU 的队伍,为 Twitter 旗下 X.AI 的大型语言模型项目购入了大约 10000 颗英伟达的 GPU。

实际上,马斯克也曾计划推动特斯拉研发自有通用 GPU 用于数据中心等场景:2021 年特斯拉在 AI Day 活动中发布了 D1 芯片,与 A100 一样搭载 500 亿颗晶体管,但这款产品并未像英伟达的 GPU 产品那样历经快速迭代更新,至今这颗芯片仍未发布迭代产品。

其中的原因或许马斯克早已说明:在今年第二季度特斯拉财报电话会上,马斯克表示他之所以投资超过 10 亿美元用于 D1 芯片的研发,只是因为特斯拉无法得到足够的英伟达 GPU,并表示英伟达如果能提供足够的 GPU「特斯拉就完全没有开发 D1 的必要了」。「但可惜的是,英伟达甚至不能提供我们所要求计算量中的一小部分」马斯克同时吐槽到。

这或许也是很多厂商在购买英伟达 GPU 的同时,也在着手自研的真正原因:Google / 微软都是无厂半导体厂商中的一员,在这片战场中还有类似 IBM、特斯拉等选手。大洋彼岸,中国 AI 研究者对于算力的需求甚至要美国的同行更加迫切:根据中国信通院算力白皮书信息显示,美国、中国、欧洲、日本在全球算力规模中的份额分别为 34%、33%、14%与5%,其中全球基础算力美国份额达 37%,中国以 26% 份额排名第二。

在 2022 年美国政府禁止英伟达出口 H100 与 A100 给中国客户之后,位于中国的 AI 研究机构与企业纷纷开始寻找可行的替代方案 —— 自研当然是大厂会优先考虑的选项之一。

从硬件来讲,实现超过英伟达 GPU 的硬件算力并不是最难的那个目标 —— 至少「第二梯队」的竞争对手至少能做到不被甩开太远,国内壁仞、天数智芯等企业都在从事高算力通用 GPU 的研发。

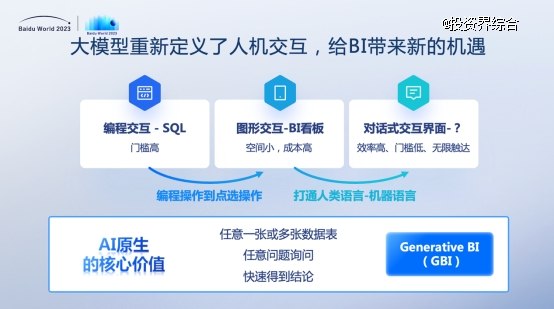

甚至在针对训练或推理等独立场景应用的领域,着力通用场景的 GPU 可能并不是负载最高效的选择,类似 Google、亚马逊,国内阿里云,百度研发多年的专用集成电路(ASIC)芯片 TPU 或许更加合适,这些选手在 2024 年都有可能在算力上反超 H100。百度将于 2024 年发布的昆仑芯三代,算力即对标英伟达 A100。

随着摩尔定律的失效,以及半导体前沿制程探索的高昂花费与难度双双飙升,英伟达 GPU 的硬件性能虽仍然强大却并非遥不可及,同时竞争对手也有足够的资本参与到最新制程的研发中,在某一天突然拿出与英伟达平分秋色的产品:英伟达的老对手英特尔便是最鲜活的例子。

英伟达可以赢下每一次,但竞争对手只需要赢一次,就足以撬动市场,让英伟达的地位不再稳固。

真正让后来者感到畏惧的,硬件只是部分原因,数百万计从事 AI 开发与深度学习的开发者,或许是另一个推动英伟达成为事实上垄断企业的「护城河」。

2007 年,英伟达发布了基于 Telsa 架构的第八代 Nvidia GeForce GPU,同时发布了面向开发者使用英伟达 GPU 来进行图像处理之外运算的开发编程环境 —— CUDA,来让当时的开发者可以不用再去学习复杂的着色语言以及图形处理原语,即可使用自己熟悉的代码语言编程。

与此同时,英伟达开始着手组建 AI 深度学习研究团队:Bryan Catanzaro 在 2008 年初加入英伟达时,他发现全公司只有他一个人在从事深度学习领域硬件研发工作的员工。

「在 CUDA 发布后的十年中,华尔街都一直不看好它,并且认为没有人会使用它」Bryan Catanzaro 曾这样形容英伟达早期在构建自有机器学习软件生态时面临的的阻力「在英伟达的市值中,CUDA 的估价是零」。

如今 Bryan 已经是英伟达副总裁,统领英伟达数千名从事这一领域研究的员工。而 CUDA 在发布后的十年中一直寂寂无闻,直到 2016 年,人们才突然意识到这是一款与之前截然不同的一种开发工具,能以革命性的加速能力推动人工智能领域的研究速度:在 CUDA 之前,开发者想要编写代码让 GPU 完成大量通用计算是一件非常繁琐的工作。CUDA 作为与英伟达硬件深度耦合的开发环境,也决定了即使如今 CUDA 生态已经枝繁叶茂,其他 AI 芯片公司也无法完全兼容这套生态,更无法保证能实现足够的效能与一致性。

英伟达如今强大的盈利能力,也进一步支撑 CUDA 平台与英伟达的 GPU 能够紧跟时代,成为下一个时代诞生的梦工厂:去年发布的最新一代 GPU H100 包括了大量硬件升级,同时采用了台积电最新的 4N 工艺制造 —— 这一一项专为英伟达 GPU 打造的 5nm 工艺。让 H100 能够容纳 800 亿颗晶体管。让相同大模型训练所需 GPU 数量能降低至 A100 的三分之一。

正如同 iOS+iPhone 这套黄金组合之于苹果,黄仁勋的远见,让英伟达在软硬件结合领域十余年如一日的巨额投资,不仅让 GPU 成为下金蛋的鹅,也最终形成了任何竞争对手都难以撼动的生态壁垒。完全可以说这是一家伪装成硬件公司的软件公司。

2016 年,黄仁勋亲自前往旧金山,将世界上*台*用于人工智能的超级计算机 DGX-1 送给刚创立不久的 OpenAI,这台当时的性能怪兽立即就被投入到一项名为「生成模型」的技术研究中:这项计划旨在开发能够读懂、辨别人类语言、自行收集运用资料,实现聪慧如人的反应的对话程序。

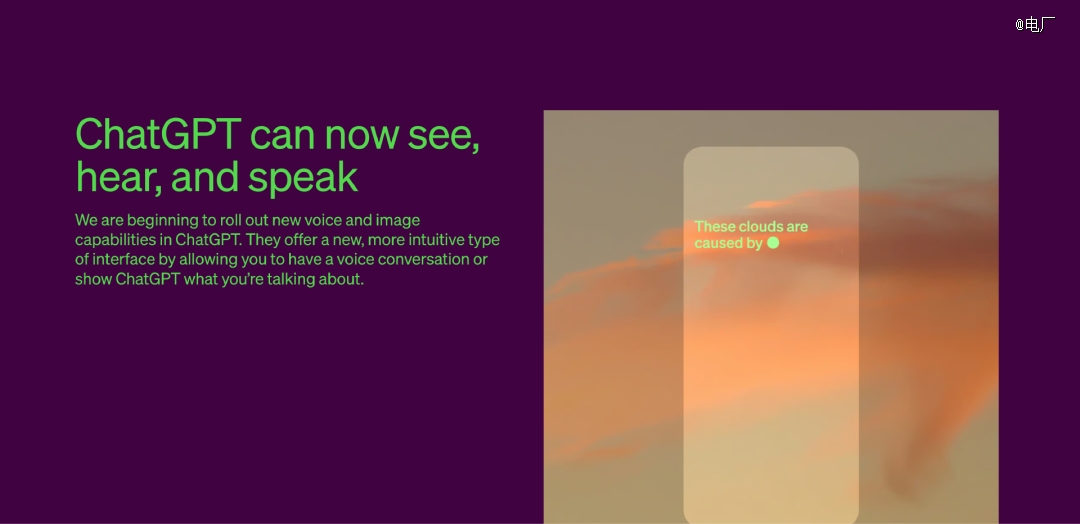

如今每个人都已经知晓这个故事的最终结局 —— ChatGPT 即为这一项目迄今孕育出的最辉煌的诞生成果;2023 年 9 月 25 日,OpenAI 官方博客也宣布了 ChatGPT 的更新:首次推出多模态功能,ChatGPT 开始支持语音与图像的识别与内容创作,OpenAI 为其聘请了专业配音演员创作声音内容,人类用户终于能通过语音来与 ChatGPT 直接对话。

从 2016 年 OpenAI 拿到*台 DGX-1 用于研究,到如今 ChatGPT 仅每天用于日常运行的 HGX A100 服务器数量就达到了 3617 台。无论过去的道路如何曲折,英伟达作为这个时代*的赢家之一,还是推动着人工智能行业那个「聪慧如人」的目标,又迈进了一小步。

即使竞争对手的阴云已经开始聚集,黄仁勋在 2006 年的决定,还是让英伟达能「用时间换空间」,用十余年的时间给英伟达修建了一条护城河。对于任何有志取英伟达而代之的厂商而言,其中的巨大差距都需要时间与金钱的投入来弥补。而时间与金钱似乎都站在了英伟达一边。

《巴伦周刊》作家 Tae Kim 最近计算表示,英伟达每销售一块 H100,就能从其中获得 1000% 的利润。从硬件 BOM 表单上来算,售价超过三万美金的 H100 给英伟达带来的毛利率超过了 90%,即使是台积电,也只能从其中拿到 1000 美元的收入。

这些恐怖的盈利能力,反过来被英伟达进步用于巩固自己的护城河,英伟达目前在全球有超过两万名员工,平均年薪为 20 万美元,同时维持研发费用在 20% 以上;没有工厂的英伟达,多年保持着超过特斯拉与苹果的研发投入。

事实上,微软也并未寄希望于自研 GPU 芯片项目能够一举击败英伟达:微软与英伟达联手打造的打造的下一代超级计算机已经在路上,即使笑里藏刀,但巨头们仍愿意为了更高的股价通力合作。但在可以预见的未来,通用 AI 芯片被英伟达继续垄断仍会是现实。或许只有在两三年之后,我们才会见到下一个「AI 时代的英伟达」的诞生。

【本文由投资界合作伙伴电厂授权发布,本平台仅提供信息存储服务。】如有任何疑问,请联系(editor@zero2ipo.com.cn)投资界处理。