人形机器人上一次这么火,还是2016年波士顿动力的Atlas。

Atlas的名场面是被波士顿动力员工一棍子撂倒,整个过程栩栩如生,引发了“停止霸凌机器人”的后现代哲学思考。

后来,改进版的Atlas完成了后空翻等一连串高难度动作,在公司内部的地位提升肉眼可见。但波士顿动力的走向却和舆论热度成反比:

2013年被谷歌收购,2017年被甩卖给软银,2020年又卖给了韩国现代,逐渐泯然众人。

带起当下人形机器人节奏的,是个既出乎意料又情理之中的名字:特斯拉。

从2021年到现在,特斯拉的人形机器人以每年一次的频率,稳定的刷着存在感:

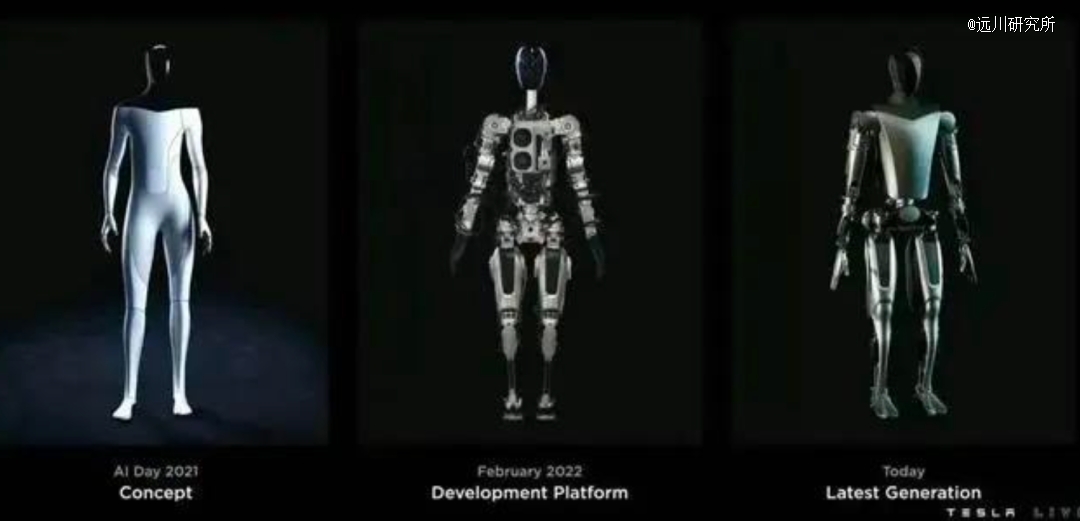

·2021年AIDay,特斯拉PPT首发了人形机器人Optimus的概念机设计方案,由于缺少后空翻这种直观冲击,影响力只局限在A股相关概念股。

·2022年的AIDay,特斯拉把Optimus的原型机搬到了会场。身高还是一米七,体重从上一年的50kg暴增至73kg,可以完成招手、搬运物体等简单工作,但走路需要特斯拉员工搀扶。

·2023年股东大会,Optimus以视频形式出场,不仅走路不用人扶了,还能完成物品分类、分拣等更高难度动作。

Optimus体重暴增前后

虽然在舆论场的声量远不及当年的波士顿动力,但特斯拉的Optimus引发了产业界的沸腾,原因有两点:

一是相比Atlas百万美元的造价,马斯克表示Optimus两万美元就能买回家,说明人形机器人有大规模量产的可能。

二是通用性,在特斯拉的演示视频里,Optimus已经可以完成很多简单的体力劳动,潜在销路大增。

问题随之而来:为什么是现在?为什么是特斯拉?

一次技术浪潮

理解人形机器人的技术浪潮,首先要了解它和传统的工业/服务机器人的区别。

简单来说,传统机器人大多基于特定的规划执行特定的操作,比如运输、分拣,不具备感知和决策能力。人形机器人不仅能与物理世界交互,还有感知和理解能力。

举一个不太恰当但好理解的例子:送餐机器人执行“把外卖送到1203号房”这个任务时,并不理解什么是“外卖”和“1203号房”,只是根据软件系统既定的指令和路线规划完成任务。

但人形机器人可以借由智能化,理解物理世界各种物体、语言和文字的含义,并自主规划和决策。

所以理想状态下,机器人不仅可以送外卖,还能顺便洗个碗,走之前再把垃圾带下去。当然马斯克想的更远:让Optimus军团搭乘SpaceX的龙飞船登陆火星。

因此,两者的*区别就在“通用性”,一个只能完成预先规划的特点任务,一个理论上什么都能干。

技术跃迁的背后,是人工智能近20年来的两次里程碑事件:

*次是2012年,Geoffrey Hinton三人组携AlexNet算法参加ImageNet图像识别大赛,以84%的识别准确率夺得冠军。神经网络从多种技术路线中脱颖而出,成为人工智能的*解。

所谓神经网络,可以理解为用算法模拟人脑的运行机制,配合足够规模的数据和算力,理论上人脑能够实现的智能,计算机也能实现。李飞飞举过一个形象的例子:

如果把眼睛当作照相机,一个三岁的孩子就已经拍摄了上亿张照片,借此认识世界。那么只要让算法看足够多的图片,算法也能够识别物体。

2012年,李飞飞创建的数据集,AlexNet在算法上的创新,加上Geoffrey Hinton三人组开创性的使用了英伟达显卡训练算法,数据、算法、算力齐备,人工智能迎来爆发期,人脸识别、机器翻译、自动驾驶等场景迅速落地,GPU订单雪花一般飘向圣克拉拉的英伟达总部。

顺带提一句,Geoffrey Hinton的新东家Vayu Robotics,就是一家做机器人的公司。

第二次是2017年,Google八位员工公开了Transformer架构,开启了大模型时代。

两次的区别可以简单概括为,2012年的AlexNet让AI有了“感知”的能力,而Transformer和之后的大模型让AI有了“生成”的能力。

举例来说,2012年的AI可以识别出各种各样的猫,2017年之后的AI已经可以自己生成猫的图片了。

“感知”让AI能够学习人类对世界的认知,“生成”让AI有自主决策的能力。至此,机器人的地基已经打好了。实际上ChatGPT和各类AI Agent,已经可以视为具备感知和决策能力的机器人。

只不过这类“机器人”局限在数字环境,有量大管饱的参数和算力就能搓出来。但人形机器人需要与真实的物理世界交互,就需要真实世界的参数训练。同时,由于硬件产品的存在,又会触及制造业的核心命题:低成本大规模量产。

从早年的本田ASIMO,到几年前的波士顿动力Atlas,都是栽在了无法低成本量产,导致没有商业化场景的问题上。

而特斯拉进展神速的秘密在于,他们抓住了人形机器人的“前置产业”:自动驾驶。

一个“前置产业”

2021年的AI Day上,马斯克曾说:我们几乎拥有人型机器人所需的所有部件,因为我们已经制造了带轮子的机器人。

这句话其实很好概括了特斯拉在人形机器人上的发展策略:用汽车研发的经验给机器人开路。

如上文所说,本轮人形机器人浪潮的想象空间在于“通用性”,也就是把机器人从基于特定规划执行任务的功能性产品,变成具备感知和决策能力的智能设备。

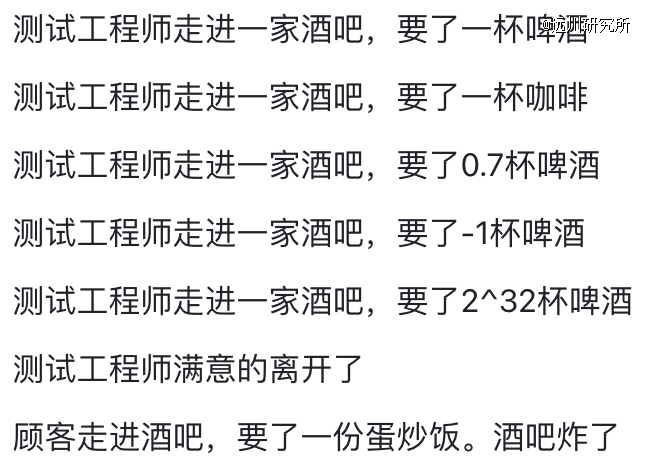

此前的种种智能化路线,往往都难以脱离“穷举法”的桎梏,导致始终会面临像这个程序员段子一样的尴尬问题:

但Transformer打开大模型时代后,带来了两个立竿见影的改变:

一是把无法实现的穷举法变成了简单粗暴的大力出奇迹:只要让机器学习足够多的数据,就能拥有类人的智能,可以脱离预设的规划进行自主决策。

二是多模态能力的建立,让机器人可以实现感知-决策-执行的整个流程。

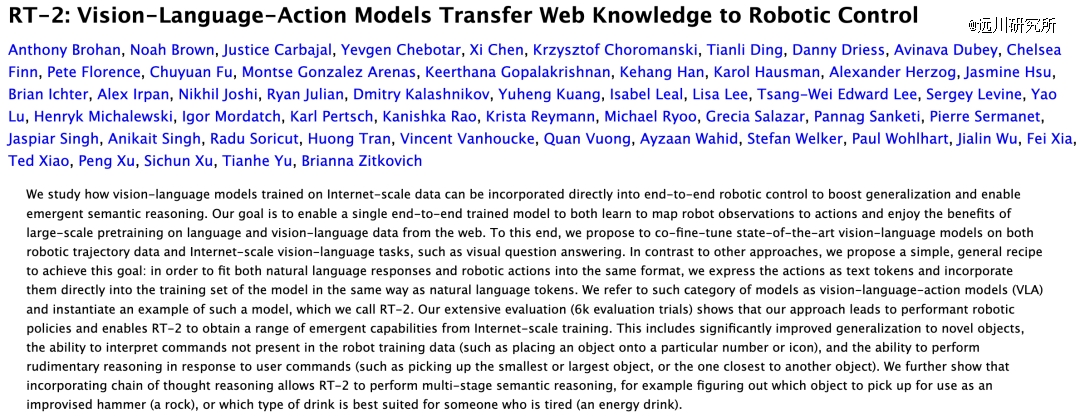

一个样板工程是今年7月《纽约时报》探班谷歌实验室, 完整记录了基于RT-2模型的机器人智能闪现的瞬间:

桌子上放着恐龙、鲸鱼、狮子三个塑料玩具,工程师让单臂机器人“捡起灭绝的动物”,机器人拿起了恐龙。

这意味着机器人不仅能识别三种动物,也能理解“灭绝的动物”的含义,还可以完成具体的操作。

以此类推,只要数据、算法、算力三要素满足,那么机器人不仅能抓取灭绝的动物,还能自己切菜刷锅洗碗,甚至先切十斤精肉不见半点肥的,再切十斤肥的不见半点精肉。

如果可以实现,那么机器人的应用场景就大幅度增加,比如做饭、打扫卫生、照顾老人。而且机器人还会依照算法不断自我学习自我进化,自驱力秒杀99%的打工人。

Google的RT-2模型论文

自动驾驶的技术演进一度万马齐喑,就在于难以脱离“穷举法”的陷阱,直到以神经网络为代表的人工智能兴起。而人形机器人的既定发展路线,恰恰与自动驾驶的技术演进完全吻合:

两者的核心都是基于人工智能,实现感知-决策-执行的完整链条。

这就意味着无论是软件层面的算法,还是硬件层面的视觉传感器、FSD芯片等零部件,理论上都可以用于人形机器人。这也是为什么马斯克会说:当你能解决自动驾驶,你就能解决现实世界中的人工智能。

如果把新能源车理解为“带轮子的机器人”,那么特斯拉的布局其实可以追溯到2014年9月*版Autopilot发布。在这过程中,特斯拉一步步用自研软硬件替换掉了第三方的方案,为Optimus机器人探路。

最核心的自动驾驶芯片上,特斯拉最初采用Mobileye的方案,后来换成了英伟达。2019年,特斯拉自研的FSD芯片正式上车,沿用至今。

软件算法上,特斯拉在2020年对底层代码进行了网络重构,引入了Transformer架构,实现将2D图像拼接为3D视角,随后又3D空间基础上加入了时序信息,转化为4D空间。2022年引入占用网络(Occupancy Network),解决通用障碍物识别问题。

云端算力上,特斯拉在2021年AI Day首次公开了Dojo超算和自研的D1芯片。至此,特斯拉完成了从云端到终端,核心软硬件的自研。

因此,Optimus在2021年的公开亮相,并不是巧合。

一家伪装成汽车制造商的AI公司

为什么波士顿动力的Atlas成本高达百万美元,特斯拉Optimus的目标价位只有两万美元?

因为那98万已经由广大特斯拉车主先行分摊了。

虽然机器人所需的数据集与自动驾驶有所不同,控制系统也有差别,但自动驾驶还是*的帮人形机器人解决了“VR式难题”。

VR经历了无数个“元年”依然死气沉沉,核心在于如果要满足VR头显对性能、体积和能耗的要求,手机的研发经验几乎无法复用,软件系统和处理器、屏幕这些零部件,都要重新走一遍从0到1的过程。

在产品不成熟、应用匮乏的情况下,消费者兴致寡然,导致企业无法大规模生产摊薄成本,而高昂的售价又进一步加剧这个恶性循环。

人型机器人则相反,研发过程中耗资巨大的软件算法、数据采集、芯片和传感器等零部件、云端算力设施,都在自动驾驶的开发过程中建设完成了。

几乎所有人工智能的应用都需要算法、算力、数据三驾马车来拉动,算法决定了AI识别和决策的方式;但强大的算法需要足够的算力来驱动;同时,算法的提升又需要大规模高质量的数据;三者相辅相成,缺一不可。

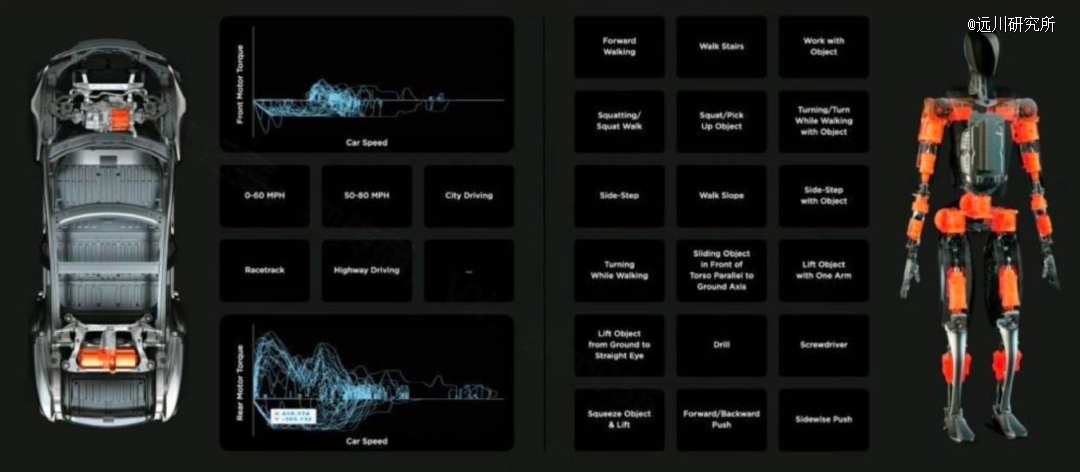

具体到人形机器人,Optimus的每一个环节,都能照抄S3XY四大车型的作业。

算法层面,Optimus的软硬件几乎照搬了特斯拉电动车的方案:

Optimus共配置有3颗摄像头,左右眼各一个,外加一颗鱼眼广角。芯片是和电动车一模一样的FSD自动驾驶芯片,参照当前HW3.0系统的算力,Optimus的算力为72TOPS(车里有两颗,机器人只有一颗)。

软件上,Optimus承袭了特斯拉自动驾驶的BEV+Transformer+占用网络的方案。简单来说,算法会将摄像头拍摄的画面“拼”成一张动态的4D图像,并规划行车路径。在Optimus的演示里,其识别和决策系统与自动驾驶算法如出一辙。

Optimus的视觉传感系统

2023年特斯拉股东大会,马斯克就表示,特斯拉已经打通了FSD和机器人的底层模块,实现了一定程度的算法复用。

算力层面,依靠2021年发布的D1芯片,特斯拉组建了自己的算力集群DojoExaPod。

一套Dojo ExaPod包含3000个D1芯片,总算力达到1.1EFLOP,相当于14000块A100的算力。Dojo主要服务于特斯拉的自动驾驶任务,但也可以无痛切换到机器人的训练。特斯拉为汽车设计的碰撞模拟软件,也可以给Optimus编写跌倒测试程序。

数据层面,特斯拉已经拥有了规模*的数据采集网络。

和GPT等大模型不同,自动驾驶与机器人需要物理世界的真实数据来训练算法。与自建工程车队,专门采集数据的自动驾驶公司不同,特斯拉车主组成了一个规模庞大的免费外包车队,加上近30万购买了FSD功能的车主,源源不断的将真实数据传送给Dojo训练。

2022年的AI Day上,特斯拉宣称已经存储的有价值训练数据集有23.2万帧,验证数据集0.38万帧。

Optimus中负责驱动的电机也来自特斯拉电动车现有的方案。不过考虑到机器人的灵活性更强,单独的电机数量远远超过电动车。

总结一下,新能源车和自动驾驶可以靠自身的造血能力,替人形机器人趟过研发开支最密集的阶段;同时,自动驾驶的落地也为人形机器人积累了大量数据采集、算法迭代、模型训练的工程化经验。

波士顿动力的日益平庸,特斯拉的后来居上,背后的变量都是人工智能的技术革命,和自动驾驶这个“前置产业”。

马斯克在AI领域的涉足常被忽略,他其实是OpenAI的创始人之一,也是DeepMind的早期投资人。他参与的人工智能公司还有脑机芯片Neuralink、聊天机器人Grok。

特斯拉每天接受并处理的视频画面超过1600亿帧,这是商业公司能拥有的*的真实世界数据集,不仅能拿来精进自动驾驶系统,还能给Optimus做预训练。

人们觉得特斯拉属于制造业,其实它更像一家软件公司。特斯拉的自我介绍是“纯电动车、太阳能和清洁能源”,但实际上,它是一家彻头彻尾的人工智能公司。

【本文由投资界合作伙伴远川研究所授权发布,本平台仅提供信息存储服务。】如有任何疑问,请联系(editor@zero2ipo.com.cn)投资界处理。