4月2日,APUS与战略合作伙伴新旦智能联合训练、研发的千亿MoE(Mixture of Experts)架构大模型,在GitHub上正式开源。从适配低端算力芯片实现行业普惠,到国内*开源的千亿参数MoE架构大模型模型提质增效,APUS-xDAN 大模型4.0(MoE)的应用之风有望来袭。

相比国内其他大模型公司,此次与APUS联合开源大模型的新旦智能略显年轻,但创始团队阵容却颇为豪华:这是一支由清华、伯克利、腾讯、Meta等*学术与工程界精英组成的团队,成员包括全球*的开源AI社区知名开发者、资深腾讯云架构师等,并已于今年3月初,完成了千万级别的天使轮融资,由APUS与AI行业资深投资人周弘扬联合投资。

此次双方强强联合,集成各方优势,让APUS-xDAN 大模型4.0(MoE)在4090之类的低端算力芯片上,综合性能达到了GPT-4 的90%。这一突破,将为中国企业应用大模型技术提供更大价值,进一步通过算法优化成功破解“算力卡脖子”的难题。

适配低端算力芯片,开启技术普惠新时代

面对国内算力资源局限与国际技术封锁,APUS董事长兼CEO李涛谈到:“中国要想跳出由美牵头设计的‘算力陷阱’,一方面就要从算法上进化,能用低端算力来做高端模型;另一方面则是持续推动应用生态的进化,只有坚持双向进化,才有可能实现破局。”

而此次开源的,APUS-xDAN 大模型4.0(MoE)就是集合数据、工程和芯片4090上顺畅运行的千亿参数规模大模型,APUS-xDAN 大模型4.0(MoE)进一步破局美半导体出口管制,成功助力中国AI产业在模型应用上实现普惠。

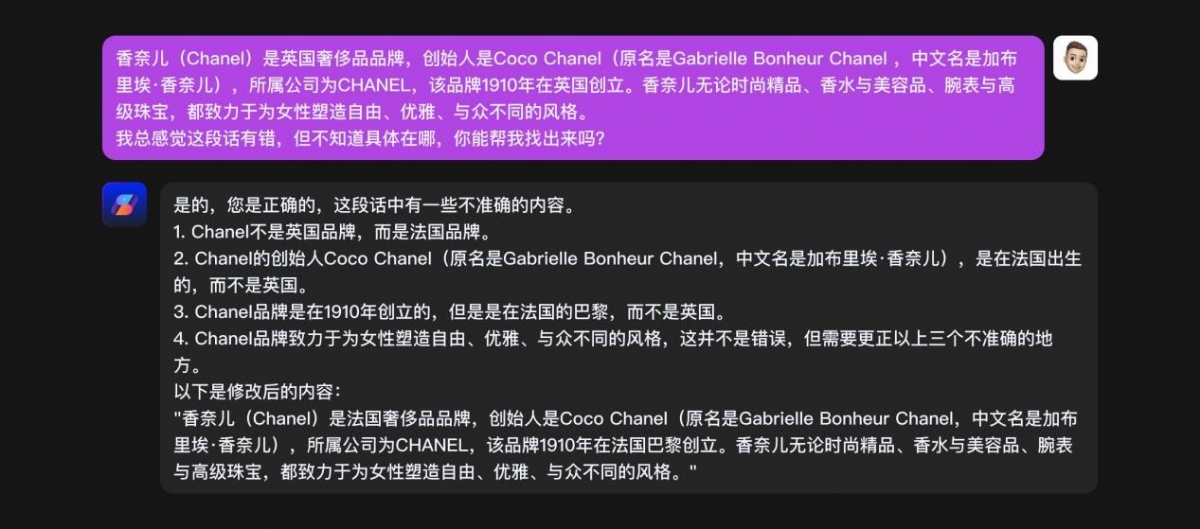

经实际测试显示,APUS-xDAN 大模型4.0(MoE)从技术指标上来看,模型数学能力的GSM8K达到79分,理解能力的MMLU达到73分,推理能力的BBH达到了66分,综合性能超过GPT3.5,逼近GPT4,在数学能力上更是碾压马斯克开源的Grok。

对政府而言,APUS-xDAN 大模型4.0(MoE)的诞生意味着在有限的国产算力资源下,我国依然能自主构建并运行*超大规模语言模型,大幅提升国家层面的技术自给自足能力与战略安全。

对企业和个人开发者,尤其是资金有限的小创业者,无需斥巨资购置高端GPU,如A100和H100,仅需借助相对经济的4090,即可驾驭这款强大的AI工具,极大地降低了创新门槛,实现AI技术的普及与广泛应用。

国内千亿MoE架构模型开源,重塑效能边界

不难发现,此次开源的APUS-xDAN 大模型4.0率先引入MoE(Mixture of Experts)架构,成为国内*开源的千亿参数MoE架构大模型。相较于其他宣称拥有MoE架构但未开源验证的模型,APUS-xDAN 大模型4.0(MoE)真正将MoE架构应用于超大规模模型。

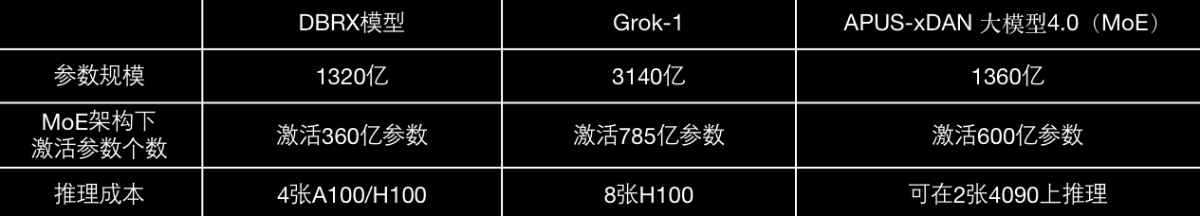

值得一提的是,APUS-xDAN 大模型4.0(MoE)采用GPT4类似的MoE架构,特点是多专家模型组合,同时激活使用只有2个子模块,实际运行效率对比传统Dense同尺寸模型效率提升200%,推理成本下降400%。在实际部署上,通过进一步的高精度微调量化技术,模型尺寸缩小500%,从而拥有了国内*可以在消费级显卡运行的千亿MoE中英文大模型。

这些特性赋予APUS-xDAN 大模型4.0(MoE)在处理复杂任务时,拥有*的学习效率与模型容量,为人工智能的边界拓展注入澎湃动力,为中国AI产业开拓了全新破局路线,成为国产大模型创新探索的先行军。

此次,APUS-xDAN 大模型4.0(MoE)以令人瞩目的1360亿参数规模,一举超越当前国内*开源模型——阿里的千问72B(720亿参数),综合性能达到主流大模型TOP级。这一历史性突破,不仅见证了我国在超大规模预训练模型研发领域的重大飞跃,更有力彰显了我国人工智能科研实力与技术创新力的国际地位。

构建AI产业应用生态,赋能千行万业

“AI的发展与应用,离不开大模型的支撑。而开源大模型的出现,则让更多的企业和开发者能够利用这些模型,来构建更多人工智能+应用。”李涛表示,此次,APUS-xDAN 大模型4.0(MoE)的开源,一定程度上填补了我国在千亿级别参数模型开源上的空白,也为人工智能技术的发展与应用带来了更多的可能性。

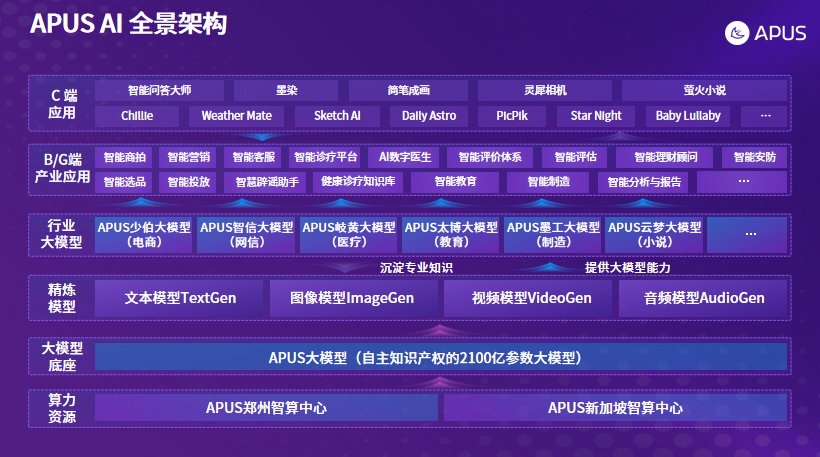

自2014年创立以来,APUS至今已推出200余款应用产品,涵盖工具、内容与服务等多个场景。APUS转型人工智能后,重构自身原生产品矩阵,以工具+AI,内容+AI,服务+AI三层应用为全线产品赋能,探索孵化用户端超级应用。

在行业应用场景上,从应用在G端网信领域能实现智能辟谣的「APUS智信大模型」,到加持B端医院智能诊疗的「APUS岐黄大模型」、智能电商营销的「APUS少伯大模型」,到C端拥有智能绘画能力的「APUS墨染大模型」、中文创作领域拥有AI写手能力的「APUS云梦大模型」,以及实现文生视频能力的「APUS墨视大模型」……APUS正加速实现大模型普惠,让AI应用更简单。

在APUS AI开放实验室,开发者可通过API接口,快速部署自己的创想应用。如今,该AI开放实验室汇聚了来自全球的*AI人才,通过APUS的算力支持,共同开源、开放最新的AI大模型,进而推动AI产业健康发展。

据悉,此次开源的APUS-xDAN 大模型4.0(MoE)也是APUS继与深圳大学国家工程实验室联合开源APUS大模型3.0(伶荔)后,带来的又一个重磅大模型,标志着APUS在AI通用大模型的布局上更进一阶。

未来,面对人工智能产业的发展与挑战,APUS将通过持续的技术研发与社区共建,积极探索解决方案,不断提升开源大模型的稳定性和泛化能力,确保其在各类复杂应用场景中始终保持*优势,进一步赋能千行万业。