5月22日,全球资本市场的“大网红”英伟达发布了2025财年*财季(截至2024年4月28日)的报告。

数据显示,本季度英伟达业绩全面大超预期,尤其是在AI加速扩张的驱动下,数据中心业务更是表现亮眼。具体来看,报告期内英伟达录得营收260.4亿美元,同比增长262%,其中数据中心业务营收226亿美元,同比增长427%,营收占比87%;与此同时,受益于数据中心业务的高利润驱动,报告期内公司录得净利润148.8亿美元,同比增长628%。

在财报发布前,市场对英伟达本季度业绩飙升已经有了较为明确的预期,受此影响,公司股价在美股盘前仅小幅上涨了0.02%;但在业绩公布后,全面超预期的财务数据还是给投资者带来了不小的惊喜,美股盘后,公司股价突破1000美元,大幅上涨6.05%。

对游戏爱好者而言,英伟达并不陌生,其是全球游戏显卡的龙头。事实上,在很长一段时间里,游戏GPU及相关产品也确实是英伟达的主要收入来源。2016财年,公司总营收50.1亿美元,其中游戏GPU业务达到28.18亿美元,数据中心业务则为3.39亿元。

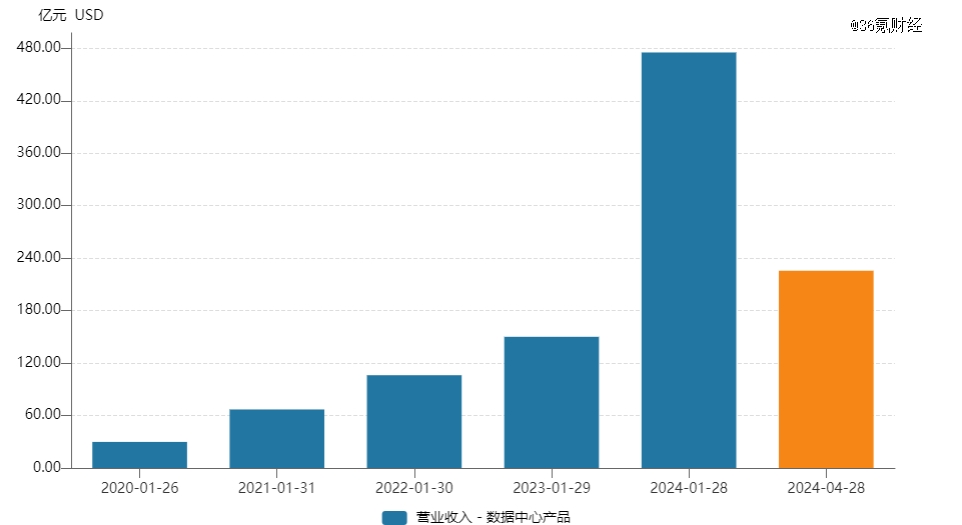

但近几年,随着云计算的逐渐兴起,远程办公、挖矿热潮等推动英伟达数据中心GPU业务相关的收入快速增长。2023财年(2022年2月-2023年1月),英伟达数据中心业务首度营收超过游戏,成为公司的*大业务,当年英伟达总营收269.74亿美元,数据中心产品150.05亿美元。

自此,英伟达数据中心业务开启狂飙模式。

2024财年,在大模型对GPU需求暴涨的大背景下,英伟达总营收暴涨126%至609.22亿美元,而数据中心业务的营收同比则激增217%至475.25亿美元,在营收结构中的占比接近80%;而在最新一季的财报中,其数据中心业务更是同比大幅增长了427%,营收占比进一步增加至87%。

图:英伟达数据中心产品营收增长

数据来源:wind、36氪整理

数据中心GPU业务的持续放量,推动英伟达身份属性从硬件厂商向AI算力龙头转变。新的定位为其在资本市场带来了巨大的估值想象空间,推升公司股价创下两年五倍的神话,总市值更是跃升到2万亿美元之上。

英伟达的崛起成为了AI浪潮下最真实的写照——紧握AI时代的钥匙,带来意想不到的机会空间。那么,英伟达为何可以成为这一波AI浪潮下的*受益者?我们又该如何搭上AI浪潮的快车,从英伟达概念中掘金?

英伟达崛起背后:算力需求的激增

我们认为,英伟达业绩的爆发主要受益于AI行业对算力需求的激增。

2022年底,ChatGPT的面世,正式将AI带入大模型时代。

海内外大语言模型的快速涌现和迭代、模型性能的提升,使得训练和推理持续扩张,带动算力需求呈现出指数级增长趋势。

海通证券指出,以OpenAI为例,训练一次1750亿参数的GPT-3大约需要的算力约为3640PFlops-day,共使用了1024块A100(GPU)训练了34天。而GPT-4参数量达到了GPT-3的500倍,使用约2-3万张A100,训练1个月左右时间。

在英伟达GTC大会上,黄仁勋也讲到,如果要训练一个1.8万亿参数量的GPT模型,需要8000张H100 GPU,消耗15兆瓦的电力,连续跑上90天。

东吴证券预计,推理算力需求将是训练的数倍,高达几十万张H100,随着模型继续迭代,算力需求只会越来越大。根据IDC预计,数据中心GPU市场预计将从2022年的103亿美元增长至2027年的654亿美元,CAGR达到44.55%。

算力的实现需要以AI服务器为载体,而AI服务器则是包含GPU、CPU、存储、通信技术等在内的庞大产业链。

根据TrendForce数据,2022年全球AI服务器出货量达到85.5万台,预计2026年全球AI服务器出货量为236.9万台,2022-2026年CAGR高达29.02%,远超全球整体服务器市场增速。

就中国市场而言,根据 IDC 和浪潮信息联合发布的《2022-2023年中国人工智能计算力发展评估报告》,2021年中国AI服务器市场规模59.2亿美元,预计到2026年将达到123.4亿美元,2021-2026年CAGR达15.82%。

因此,AI服务器需求的激增,使得市场对英伟达数据中心GPU的需求高增,而英伟达从GPU向AI服务器整机的业务衍生,也给公司的营收带来了巨大的增量。

了解英伟达,要关注哪些产品?

根据英伟达官网披露,在每一代的GPU架构下,公司会将旗下的GPU按品牌分类进入GeForce、NVIDIA RTX/Quadro、数据中心三个品类。其中,GeForce系列主要应用于游戏行业,属于消费级GPU;NVIDIA RTX/Quadro主要应用于工业设计、媒体开发等专业级别领域;从GPU的性能横向对比来看,分类进入数据中心相关的GPU往往是英伟达的王牌产品。

前文提到,AI服务器需求的大爆发,已经使得数据中心GPU相关产品成为英伟达*的收入来源,且相关产品收入增速惊人。基于此,本文我们讨论英伟达供应链时,*的增量即来自数据中心的GPU相关业务。

那么,数据中心主要需要哪些GPU芯片?

我们可以根据英伟达的命名规则,来大致推测其一款GPU芯片的主要应用方向。一般来说。名称前缀带GeForce的即主要应用于游戏等消费领域;名称中没有GeForce但有RTX、Quadro的,主要应用于专业设计领域,其中RTX表明GPU具备光追功能;名称中没有前述所有字样,但直接以GPU架构开头字母命名的,如A100(Ampere)、H100(Hopper)、L4(Ada Lovelace)、B200(Blackwell)则主要应用于数据中心。

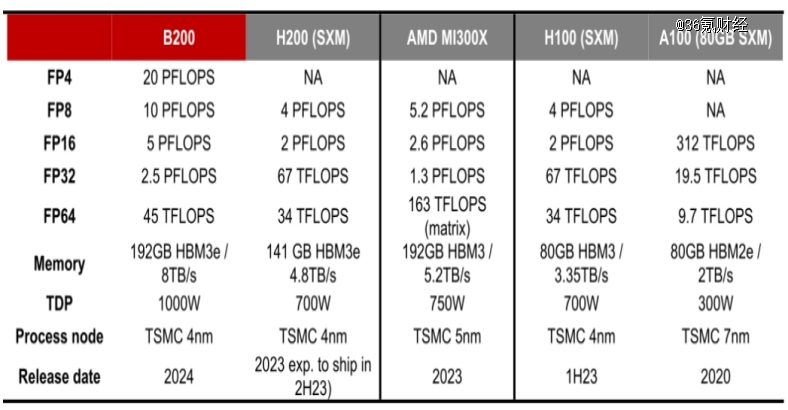

从GPU性能对比来看,2023年底AMD发布的MI300X,在浮点运算能力方面曾短暂超过英伟达当时的最新产品H200。但在2024年英伟达Blackwell架构下的B200发布后,B200的低精度运算能力又反超AMD。在终端需求,由于大模型的训练、推理往往以低精度运算为主,因此英伟达的最新GPU依然相较AMD有明显优势。此外,英伟达耗时十余年打造的CUDA软件生态,也让英伟达在软件层面建立了独特的护城河,大大提高了市场对其GPU产品的认可度。

图:英伟达数据中心GPU产品性能

数据来源:招银国际、36氪整理

不过,英伟达的野心并不只单纯局限于GPU芯片。近年来,其不断围绕GPU拓展数据中心相关的衍生业务,力图为数据中心提供一站式的产品服务与综合解决方案。

其中最典型的产品有两款,一是英伟达利用多块GPU构建的DGX系列服务器,以及多个DGX服务器组成的机架级服务器。二是可满足客户定制化需求的HGX服务器平台。

例如,在2024的GTC大会上,英伟达就发布了DGX GB200服务器,以及DGX GB200 SuperPod机架级液冷服务器。具体来看,DGX GB200 SuperPod由8台DGX GB200服务器组成,一台DGX GB200服务器由36个GB200组成,一个GB200又由2个B200 GPU和一个Grace CPU组成。

英伟达映射的投资机会有哪些?

前文所述,我们提到当下大模型的快速迭代对算力支持提出了更高的要求,而英伟达在AI服务器方面的*优势使得其对应业务呈现跨越式的扩张,同时,受益于行业前景乐观预期叠加供不应求背景下公司业绩的强确定性,2022年10月至今,英伟达股价也实现了超7倍的增长,不仅如此,与其数据中心业务相关的供应链公司,也同步实现了飞跃。

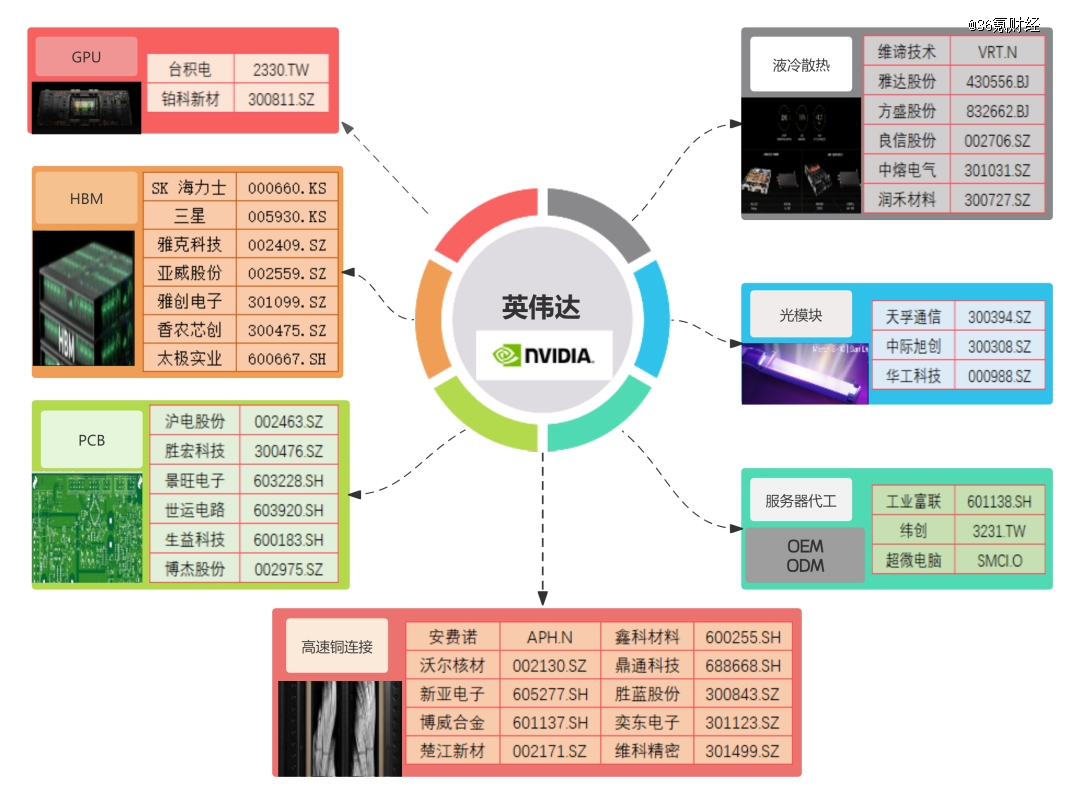

英伟达概念投资,主要是围绕英伟达王牌产品如DGX GB200 SuperPod机架级液冷服务器等的产业链构成以及对应供应链公司展开。

从产业链构成上来看,我们常说的H100、A100实际上是GPU板卡,主要包括GPU芯片、HBM等电子元器件,在此基础上,多个GPU+CPU+SSD组成AI服务器,多个AI服务器+交换机+机架,又组成服务器集群。

具体到AI服务器,根据提供的功能不同,可以分为计算、存储、互联接口、I/O、功率、固件和其它配套等板块,具体又包括GPU、CPU、显存HBM、DRAM、硬盘SSD+RAID、板内芯片互联、服务器互联、网卡、电源管理、BMS/BIOS、PCB、电源模块、散热模块、其他元器件/线缆、代工等。

在各环节的BOM占比方面,以英伟达DGX A100系统为例,根据中金证券的数据,单环节价值量占比由高到低分别为GPU(48%)、代工(15%)、SSD(10%)、显存HBM(9%)、DRAM(9%)、CPU(7%)、网卡(1%)、互联接口(0.7%)、PCB(0.6%)、散热(0.3%)、电源模块(0.3%)、其他元器件(0.1%)、电源管理(0.09%)、BIOS/BMS(0.02%)。

考虑到DGX B200系统在内部采用了铜缆连接,并配合液冷系统,因此,相对DGX100而言,预计铜缆、散热模块的价值量有望提升。根据市场数据,预计铜缆在单服务器的BOM占比有望达到5-7%。

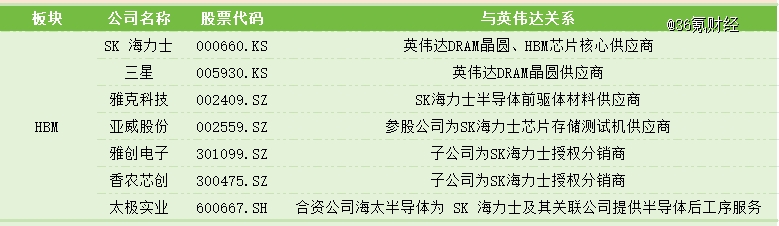

具体到各环节的公司构成上,详细数据在下边逐一展开:

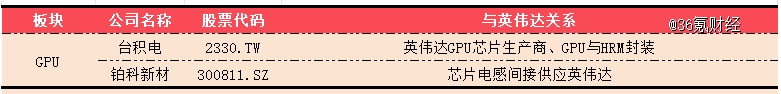

| GPU

GPU芯片产业链上中下游分别为芯片设计、芯片制造及芯片封装与测试。

英伟达处于上游的芯片设计环节,在中下游的芯片制造环节,台积电凭借先进的4nm、7nm工艺及CoWoS封装技术,成为英伟达GPU芯片制造,以及GPU芯片+HBM封装的主要厂家。

简单来说,台积电在为英伟达制造出GPU芯片后,又将这块GPU芯片与海力士的HBM芯片进行封装,然后再将封装后的产品交给其他厂商(如工业富联)进行组装,最终形成GPU板卡。目前国内企业可以参与的,主要集中在封测环节。

| CPU

AI服务器中,CPU同样是不可或缺的芯片。

如果说GPU的主要功能是运算,那么CPU就是控制GPU运算的的“大脑”。例如,英伟达DGX H100中就包括2块CPU和8块GPU芯片。

此前,英伟达DGX H100服务器中曾采用英特尔的CPU,但在其最新发布的GB200超级GPU上,英伟达采用了自研的Grace CPU。另外,英伟达发布的DGX B200和DGX GB200服务器中,还搭载了专用于加速计算的DPU芯片。

|显存

目前,显存主要包括GDDR、HBM(高带宽存储器)两种类型,由于HBM拥有高带宽优势,因此成为英伟达中高端数据中心GPU(如A100、H100、H200)的标配。

HBM是一款新型的高带宽、高附加值DRAM产品。凭借独特的TSV信号纵向连接技术,HBM内部将数个DRAM芯片在缓冲芯片上进行立体堆叠,其内部堆叠的DDR层数可达4层、8层以至12层,从而形成大容量、高位宽的DDR组合阵列。

除此之外,HBM堆栈不通过外部互连线的方式与GPU/CPU/Soc连接,而是通过中间介质层紧凑快速地连接信号处理器芯片。HBM通过3D堆叠多层DDR提供海量并行处理能力、通过集成型HBM提供极高的存储器带宽,并使得数据参数距离核心计算单元更近,从而有效降低数据搬运的延迟和功耗。在系统集成方面,HBM将原本在PCB板上的DDR内存颗粒和计算芯片一起集成到SiP,有效利用空间、缩小面积。

以英伟达A100 80GB配置4或8张GPU卡来计算,其HBM用量约为320-640GB,根据SK海力士预计,中长期内HBM需求的年增长率将达到约60%。不过,目前供给层面HBM几乎被海力士、三星、美光三家企业垄断,其中,SK海力士是英伟达HBM*大供应商,而A股的香农芯创等则通过供货SK海力士间接绑定英伟达。

|SSD

AI服务器中,SSD是继显存外的另一大储存芯片。值得注意的是,HBM是DRAM,类似于手机俗称的运存,适用于短期储存,而SSD是NAND,类似于手机俗称的内存,适用于长期储存。

SSD上游参与者主要包括闪存芯片、主控芯片厂商,中下游则主要为模组厂商。

一般来说,IDM厂商(又称原厂)不仅掌握核心闪存芯片的设计,还可以一体化完成SSD所有设计和生产流程,在SSD和SSD主控芯片领域都占有主导地位。模组厂商则主要做组装,部分模组厂商也在拓展主控芯片技术。

从行业格局来看,SSD实际上与HBM类似,海力士和三星同样占据较高的市场份额。

|互联接口:芯片互联和服务器互联

AI算力的提升方式,除了依靠单GPU性能升级外,还需要高速的芯片互联技术、系统互联技术作为支撑,从而提升GPU算力的可扩展性,形成强大的集群算力。

就英伟达而言,目前使用的互联技术主要包括:PCIe Switch、NVLink、NVSwitch等。

PCIe的特点是兼容性强,主要应用于不同制造商和设备类型之间的高效通信。目前,PCIe技术已经发展至第六代,且第七代标准已于2024年公布,预计将在2025年正式推行。民生证券统计,PCIe Switch核心的芯片技术,主要被博通、微芯科技和祥硕科技三家垄断,合计占有全球约58%的份额,国内仅边缘智芯等上市企业拥有相关技术。

此外,为了解决PCIe总线的信号衰减问题,PCIe Retimer芯片作为为信号中继器,需求量也越来越高。目前,全球量产PCIe 5.0 Retimer芯片的企业主要是两家,除了澜起之外,另一家是Astera Labs。

英伟达自研的NVLink是一种高速、低延迟的互联技术,旨在连接多个GPU以实现高性能并行计算。与传统的PCIe总线相比,NVLink提供了更高的带宽和更低的延迟,使得GPU之间可以更加高效地共享数据和通信。目前最新的第五代NVLink下,单个Blackwell架构的GPU可实现1.8TB/s的传输带宽,超过PCle Gen 5.0带宽的14倍。

此外,英伟达自研的NVLink-C2C技术,还支持定制裸片与英伟达GPU、CPU、DPU、NIC和SOC之间的互联,其GB200超级芯片中,CPU与GPU的连接即采用了该技术。

而只要提及NVLink,NVSwitch也会伴随出现,那么二者到底是什么关系?

NVIDIA中国区工程及解决方案总监赖俊杰在官方社区中指出,NVLink可以认为是一个网线,NVSwitch认为是交换机,但NVSwitch并不是一般意义上网络交换的设备,NVLink由一些差分的信号线所构成,然后NVSwitch可以接多个NVLink的端口,内部通过跨组完成数据在多个端口的转发。

以GB200 NVL72为例,目前英伟达使用了定制化的铜缆实现机柜内9个NV Switch和18个计算节点的NVLink连接。英伟达介绍NVIDIA GB200 NVL72可以在一个NVLink domain内连接576个GPU,总带宽超过1PB/S和240TB的闪存。而*的变化是NV Switch从服务器PCB板载芯片的形式调整为机柜内的9台交换机,连接能力提升至72个GPU,这就需要使用铜缆实现机柜内的NVLink连接。

|网卡

服务器通过网卡与交换机互联,将数据流通过数据帧交换方式传输到目的地。网络互联技术包括以太网、InfiniBand和Omnipath等。其中InfiniBand凭借高带宽、低延时的优势在AI数据中心和AI服务器中广泛应用。

目前InfiniBand产品为英伟达旗下Mellanox生产的HDR,可以提供端到端200Gbps带宽,英伟达相关服务器使用的网卡均为Mellanox产品。

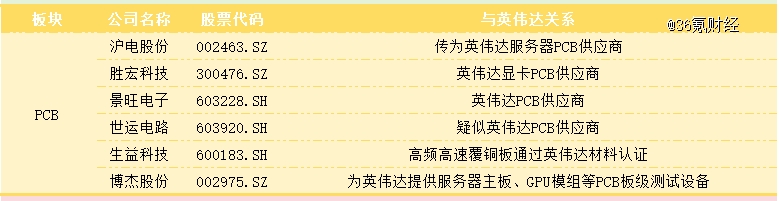

|PCB

PCB是显卡以及服务器中起支撑作用的不可或缺部件,一向有“电子产品之母”的称号。按产品类型划分,主要分为单/双面板、多层板、HDI、柔性板、IC 载板等,上游原材料主要包括覆铜板(CCL)、铜箔、半固化片及油墨等。

GPU中使用的PCB一般是多层数的高端PCB,主要应用于服务器CPU、主板、电源背板、硬盘背板、网卡以及Riser卡等部分。平安证券统计,随着当前服务器平台持续迭代,对于服务器PCB层数以及材料的要求也越来越高,PCB所需层数不仅从Purley平台的10-12层提升至Eagle Stream的14-20层,而且用料方面也要对CCL损耗等级有着更高的要求,相应带来单机PCB价值量的提升。

目前,我国在全球PCB市场的份额超过50%。国金证券指出,从格局上来看,大陆PCB厂商因配合国内服务器厂商研发和供应,已经在全球服务器PCB竞争中占有一席之地,其中沪电股份为英伟达服务器PCB供应商,胜宏科技则为英伟达显卡PCB供应商。

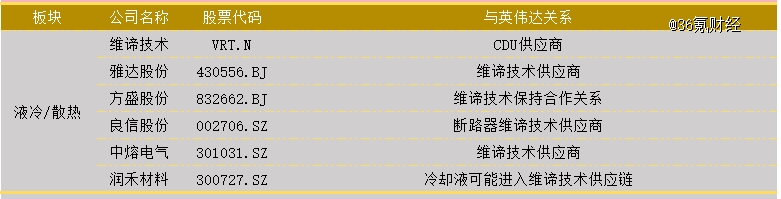

|散热模块

服务器散热系统的作用是将服务器内部产生的热量以及外界传递的热量吸收并发散到机柜之外,从而保证内部集成电路的正常温度,防止高温损伤。主流散热技术包括风冷和液冷两大类。

人工智能的快速发展带来了大量的算力和机柜需求。但受限于数据中心建设面积及环保要求,传统风冷越来越难以满足散热需求,需要液冷的不断升级弥补。在(1)芯片单点冷却方面:芯片功率密度的不断提升直接影响着芯片的散热和可靠性,逼近风冷散热上限800W左右,而液冷能有效满足芯片的散热需求;(2)机柜整体冷却方面:芯片功率的增加也导致整机柜功率的增长,采用传统风冷的数据中心通常可以解决12kW以内的机柜制冷。随着服务器单位功耗增大,同样尺寸的普通服务器机柜可容纳的服务器功率往往超过15kW,相对于现有的风冷数据中心,已逼近空气对流散热能力天花板,液冷或将成为*选择。

目前英伟达DGX GB200服务器使用的就是液冷技术,液冷系统的主要合作伙伴是美股上市的维谛技术(Vertiv),国内部分供应商通过进入维谛技术产业链实现间接联系。

|铜缆

如前文所述,目前在第五代NVLink技术下,GB200服务器内部使用了约5000根铜缆(共计2英里)进行交换机和GPU之间的连接。DAC(高速铜缆,速率>10GB的短距离传输)是成本相对较低的的高速互联方式,不包含电子元件,成本仅为光模块的1/5,且功耗低、延迟和插入损耗低,可以替代电子或光学连接器用于短距离的高速传输网络。

目前英伟达高速铜连接的主要供应商是美国的安费诺,国内并无直接参与机构,但部分企业通过供货安费诺实现了间接联系。

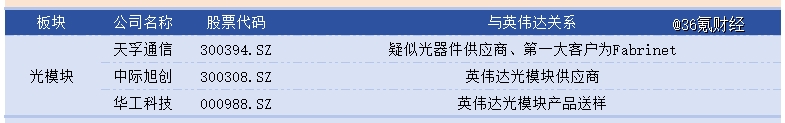

|光模块

目前,英伟达用第五代NVLink和第四代NVSwitch构建多层NVLink网络,实现576个GPU的直接互联和共同访存。在这种互联方案中,GPU与机柜内部NVSwitch之间采用铜缆连接,而不同层级的NVSwitch之间则仍然采用光互联,因此光模块的数量仍然是稳中有升的。

根据SemiAnalysis的测算,鉴于DGX GB200 NVL72拥有72个OSFP端口,每个端口对应于1个400G或800G光模块,随着GB200数量的增加,网络拓扑结构发生变化,最终GB200对应于800G光模块的数量关系将介于1:2.5到1:3.5之间。

|交换机

如果将多台DGX服务器组合成为一个集群,那么就需要用到交换机。

交换机是用于电光信号转发的网络设备,可以为接入交换机的任意两个网络节点提供独享的电信号通路。例如,英伟达DGX H100 SuperPOD中就包含32台服务器,以及12台交换机。

2019和2020年,英伟达相继收购交换机企业Mellanox和Cumulus,亲自下场生产交换机产品。从硬件结构来看,交换机由机壳、电源、风扇、背板、管理引擎、系统控制器、交换模块、线卡构成。

目前,在交换机板块,英伟达主要是使用了自研的Spectrum-X800以太网交换机。

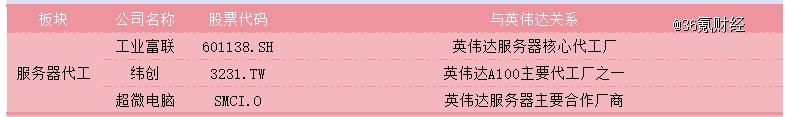

|ODM代工

在ODM/OEM代工方面,鸿海精密目前是英伟达AI服务器最主要的代工厂商,同时也是英伟达AI服务器芯片基板*供应商(超50%),也是英伟达最新的GH200芯片模组*的供应商,主要通过旗下工业富联和鸿佰科技进行AI服务器业务,同时,纬创、超微电脑等也有合作。

|其他合作商

除了以上核心环节的供应链公司外,部分A股上市公司通过其他合作方式也进入了英伟达概念名单。例如,在算力合作方面,鸿博股份、浪潮信息均有合作;在境内智算场景方面,顺网科技与英伟达有合作;千方科技子公司则与英伟达联合开发服务器;中电港则是英伟达的授权分销商;鼎阳科技为英伟达提供电子测试测量仪器。

【本文由投资界合作伙伴36氪财经授权发布,本平台仅提供信息存储服务。】如有任何疑问,请联系(editor@zero2ipo.com.cn)投资界处理。